อาการประสาทหลอนของ AI หมายถึงกรณีที่โมเดล AI โดยเฉพาะโมเดลภาษาขนาดใหญ่ (LLM) สร้างข้อมูลที่ดูเหมือนจริงแต่ไม่ถูกต้องหรือไม่เกี่ยวข้องกับข้อมูลที่ป้อน ปรากฏการณ์นี้ก่อให้เกิดความท้าทายที่สำคัญ เนื่องจากสามารถนำไปสู่การเผยแพร่ข้อมูลที่เป็นเท็จหรือทำให้เข้าใจผิดได้

อาการประสาทหลอนเหล่านี้ไม่ใช่ข้อผิดพลาดแบบสุ่ม แต่มักเกิดจาก:

- การโต้ตอบที่ซับซ้อนของข้อมูลที่คุณฝึกโมเดล

- การออกแบบโมเดล

- วิธีที่โมเดลตีความพร้อมท์

ดังนั้น การจัดการกับภาพหลอนของ AI จึงมีความสำคัญต่อความน่าเชื่อถือและความน่าเชื่อถือของระบบ AI ถือเป็นสิ่งสำคัญในการใช้งานที่คุณต้องการความถูกต้องและข้อเท็จจริง มาทำความเข้าใจรายละเอียดเพิ่มเติมกันดีกว่า

สาเหตุของภาพหลอน AI

อาการประสาทหลอนของ AI อาจเกิดจากปัจจัยหลายประการ เช่น:

การตีความ AI ผิดเนื่องจากข้อมูลการฝึกอบรมไม่ดี

คุณภาพ ความหลากหลาย และความเป็นตัวแทนของข้อมูลการฝึกอบรมส่งผลต่อวิธีที่โมเดล AI ตีความและตอบสนองต่ออินพุต ข้อมูลการฝึกอบรมที่ไม่เพียงพอหรือเอนเอียงอาจนำไปสู่แบบจำลอง AI ที่สร้างผลลัพธ์ที่เป็นเท็จหรือทำให้เข้าใจผิด การเลือกข้อมูลการฝึกอบรมที่เหมาะสมถือเป็นสิ่งสำคัญ เพื่อให้แน่ใจว่าแบบจำลองมีความเข้าใจที่สมดุลและครอบคลุมในเนื้อหาสาระ

ข้อผิดพลาดในการเรียนรู้ของเครื่องจากการติดตั้งมากเกินไป

การปรับมากเกินไปเกิดขึ้นเมื่อโมเดล AI ได้รับการฝึกบนชุดข้อมูลที่ถูกจำกัด มันทำให้แบบจำลองจดจำอินพุตและเอาต์พุตเฉพาะแทนที่จะเรียนรู้ที่จะสรุป การขาดลักษณะทั่วไปนี้อาจทำให้แบบจำลองเกิดอาการประสาทหลอนเมื่อพบข้อมูลใหม่

ข้อผิดพลาดในการตีความ AI ด้วยสำนวนหรือคำสแลง

โมเดล AI อาจประสบปัญหากับสำนวนหรือสำนวนสแลงที่ไม่เคยพบในข้อมูลการฝึกอบรม ความไม่คุ้นเคยนี้อาจนำไปสู่ความผิดปกติของเอาต์พุตของ AI

การบิดเบือนข้อมูล AI จากการโจมตีของฝ่ายตรงข้าม

การโจมตีของฝ่ายตรงข้ามที่เกี่ยวข้องกับการแจ้งเตือนที่ออกแบบมาโดยเจตนาเพื่อทำให้ AI เข้าใจผิดหรือสับสนสามารถกระตุ้นให้เกิดอาการประสาทหลอนได้ การโจมตีเหล่านี้ใช้ประโยชน์จากการออกแบบโมเดลและการฝึกอบรมช่องโหว่

วิศวกรรมพรอมต์ไม่ดี

วิธีที่คุณจัดโครงสร้างและนำเสนอพร้อมท์ให้กับโมเดล AI สามารถส่งผลต่อผลลัพธ์ของโมเดลได้อย่างมาก ข้อความแจ้งที่คลุมเครือหรือคลุมเครืออาจนำไปสู่แบบจำลองที่ทำให้เกิดภาพหลอนหรือสร้างข้อมูลที่ไม่เกี่ยวข้องหรือไม่ถูกต้อง ในทางกลับกัน ข้อความแจ้งที่มีโครงสร้างอย่างดีซึ่งมีบริบทและทิศทางที่ชัดเจนสามารถชี้นำแบบจำลองเพื่อสร้างคำตอบที่แม่นยำและเกี่ยวข้องมากขึ้นได้

เทคนิคลดอาการประสาทหลอนจาก AI

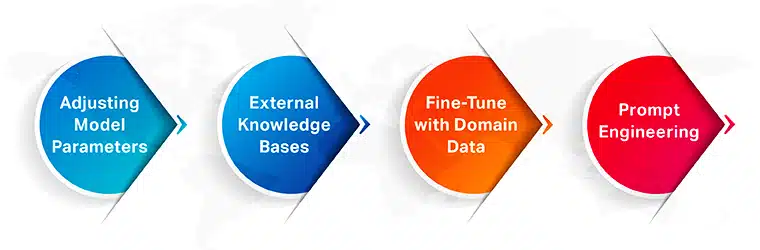

การลดภาพหลอนในโมเดล AI โดยเฉพาะโมเดลภาษาขนาดใหญ่ เกี่ยวข้องกับการผสมผสานกลยุทธ์ทางเทคนิค:

การปรับพารามิเตอร์โมเดล

การตั้งค่าพารามิเตอร์อุณหภูมิเป็น 0 จะให้ผลลัพธ์ที่แม่นยำยิ่งขึ้น อุณหภูมิจะควบคุมการสุ่มในการสร้างการตอบสนองของแบบจำลอง อุณหภูมิที่ต่ำลงหมายความว่าแบบจำลองสามารถเลือกคำและวลีที่เป็นไปได้มากที่สุดเพื่อให้ได้ผลลัพธ์ที่คาดเดาได้และเชื่อถือได้มากขึ้น การปรับเปลี่ยนนี้มีประโยชน์อย่างยิ่งสำหรับงานที่ต้องการความถูกต้องตามข้อเท็จจริงและความสม่ำเสมอ

ฐานความรู้ภายนอก

การใช้แหล่งข้อมูลภายนอกเพื่อการตรวจสอบสามารถลดข้อผิดพลาดที่เกิดขึ้นได้อย่างมาก สามารถอ้างอิงข้อมูลภายนอกนี้เมื่อสร้างการตอบสนองโดยจัดเตรียมแบบจำลองด้วยข้อมูลที่อัปเดตและตรวจสอบแล้ว แนวทางนี้จะเปลี่ยนปัญหาที่เกิดขึ้นล้วนๆ ให้เป็นการค้นหาหรือการสรุปที่ตรงไปตรงมามากขึ้นซึ่งมีพื้นฐานมาจากข้อมูลที่ให้มา

เครื่องมืออย่าง Perplexity.ai และ You.com สาธิตประสิทธิภาพของวิธีการนี้โดยการสังเคราะห์เอาต์พุต LLM ด้วย ข้อมูลที่หลากหลาย ดึงมาจากแหล่งภายนอก

การปรับแต่งอย่างละเอียดด้วยข้อมูลเฉพาะโดเมน

โมเดลการฝึกอบรมที่มีข้อมูลเฉพาะโดเมนจะช่วยเพิ่มความแม่นยำและลดอาการประสาทหลอน กระบวนการนี้จะทำให้โมเดลเห็นรูปแบบและตัวอย่างที่เกี่ยวข้องกับสาขาหรือหัวข้อเฉพาะ ด้วยวิธีนี้ คุณสามารถจัดแนวผลลัพธ์ให้สอดคล้องกับโดเมนเป้าหมายได้

การปรับแต่งอย่างละเอียดดังกล่าวทำให้แบบจำลองสามารถสร้างการตอบสนองที่เหมาะสมและแม่นยำตามบริบทมากขึ้น มีความจำเป็นในการใช้งานเฉพาะทาง เช่น การแพทย์ กฎหมาย หรือการเงิน

พร้อมรับงานวิศวกรรม

การออกแบบข้อความแจ้งมีบทบาทสำคัญในการบรรเทาอาการประสาทหลอน ข้อความแจ้งที่ชัดเจนและมีบริบทมากมายจะนำทางโมเดล AI ได้อย่างมีประสิทธิภาพมากขึ้น พวกเขาสามารถลดความเข้าใจผิดและความคลุมเครือของ AI และกำหนดทิศทางแบบจำลองเพื่อสร้างการตอบสนองที่เกี่ยวข้องและแม่นยำ

โมเดลของคุณมีโอกาสน้อยที่จะสร้างผลลัพธ์ที่ไม่เกี่ยวข้องหรือไม่ถูกต้อง หากคุณระบุความต้องการข้อมูลอย่างชัดเจนและให้บริบทที่จำเป็น

กลยุทธ์ขั้นสูงเพื่อบรรเทาอาการประสาทหลอน

คุณสามารถใช้ประโยชน์จากวิธีการขั้นสูงสามวิธีเพื่อลดภาพหลอนของ AI ในโมเดลภาษาขนาดใหญ่ ซึ่งรวมถึง:

การดึงข้อมูล-Augmented Generation (RAG)

วิธีนี้จะรวมความสามารถในการสร้างของ LLM เข้ากับฐานข้อมูลเวกเตอร์ที่ทำหน้าที่เป็นฐานความรู้ เมื่อมีการป้อนข้อความค้นหา โมเดลจะแปลงเป็นเวกเตอร์ความหมายและดึงเอกสารที่มีเวกเตอร์คล้ายกัน

จากนั้น LLM จะใช้เอกสารเหล่านี้และการสืบค้นต้นฉบับเพื่อสร้างคำตอบที่แม่นยำและเกี่ยวข้องกับบริบทมากขึ้น RAG โดยพื้นฐานแล้วติดตั้ง LLM ด้วยรูปแบบของ หน่วยความจำระยะยาว. สิ่งนี้ทำให้ LLM สามารถเข้าถึงและรวมข้อมูลภายนอกได้

การใช้เหตุผลพร้อมการกระตุ้นเตือนแบบลูกโซ่

LLM เป็นเลิศในงานต่างๆ เช่น การคาดเดาคำศัพท์ การสรุปข้อมูล และการดึงข้อมูลเนื่องจากความก้าวหน้าในหม้อแปลงไฟฟ้า พวกเขายังสามารถมีส่วนร่วมในการวางแผนและการให้เหตุผลที่ซับซ้อนได้

การกระตุ้นเตือนแบบลูกโซ่ช่วยให้ LLM แยกแยะปัญหาหลายขั้นตอนออกเป็นขั้นตอนที่สามารถจัดการได้มากขึ้น ช่วยเพิ่มความสามารถในการแก้ปัญหาการใช้เหตุผลที่ซับซ้อน วิธีการนี้ได้รับการปรับปรุงโดยการรวมตัวอย่างจากฐานข้อมูลเวกเตอร์ ซึ่งให้บริบทและตัวอย่างเพิ่มเติมสำหรับ LLM ที่จะนำมาใช้ คำตอบที่ได้นั้นแม่นยำและรวมถึงเหตุผลที่อยู่เบื้องหลัง ซึ่งจะถูกจัดเก็บไว้ในฐานข้อมูลเวกเตอร์เพื่อปรับปรุงการตอบสนองในอนาคต

การสืบค้นแบบวนซ้ำ

กระบวนการนี้เกี่ยวข้องกับตัวแทน AI ที่อำนวยความสะดวกในการโต้ตอบซ้ำระหว่าง LLM และฐานข้อมูลเวกเตอร์ เจ้าหน้าที่สอบถามฐานข้อมูลด้วยคำถาม ปรับแต่งการค้นหาตามคำถามที่คล้ายกันที่ได้รับ จากนั้นสรุปคำตอบ

หากคุณพบว่าคำตอบโดยสรุปไม่น่าพอใจ กระบวนการนี้จะทำซ้ำ วิธีการนี้ ซึ่งมีตัวอย่างจาก Forward-Looking Active Retrieval Generation (FLARE) ช่วยเพิ่มคุณภาพของคำตอบสุดท้ายโดยการปรับปรุงการค้นหาและการตอบกลับอย่างต่อเนื่องผ่านการวนซ้ำหลายครั้ง

สรุป

การเอาชนะภาพหลอนในโมเดล AI ต้องใช้แนวทางที่หลากหลาย จะต้องผสมผสานการปรับเปลี่ยนทางเทคนิคเข้ากับกลยุทธ์การใช้เหตุผลขั้นสูง การบูรณาการวิธีการบรรเทาผลกระทบจะช่วยเพิ่มความแม่นยำและความน่าเชื่อถือของการตอบสนองของ AI ได้อย่างมาก กลยุทธ์เหล่านี้แก้ไขปัญหาเฉพาะหน้าของอาการประสาทหลอนของ AI และปูทางไปสู่ระบบ AI ที่แข็งแกร่งและน่าเชื่อถือมากขึ้นในอนาคต